技術文章

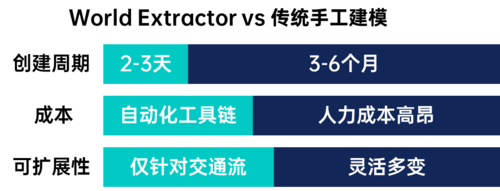

在自動駕駛開發中,高保真的仿真場景是算法迭代和驗證的基石。然而,傳統手工建模方式需要大量3D設計師投入,構建一個復雜交通環境往往耗時數月甚至半年以上;同時,城市、高速、停車場等多種運營設計域(ODD)都需要覆蓋,場景的可擴展性與多樣性一直是瓶頸。

更重要的是,隨著自動駕駛系統從模塊化架構向端到端系統級演進,仿真平臺不僅要驗證感知、決策和控制單元的單點性能,更要在同一環境中評估OneModel/TwoModel協同的整體表現,這意味著:

(1)測試場景必須與真實世界盡量一致,以避免在端到端鏈路上引入虛假偏差;

(2)需要靈活修改傳感器布局、天氣和交通流量來覆蓋邊界工況;

(3)要同時支持SIL(軟件在環)、HiL(硬件在環)、DiL(駕駛員在環)等多級仿真,并在同一數字孿生環境下復現。

然而,即使采用高保真物理渲染,仿真數據與真實世界之間依然存在域間差距(domain gap),端到端仿真測試因而受限,算法開發和功能安全驗證被拖慢。

這類端到端測試需要用戶能夠自主、快速地采集真實世界數據并生成高保真數字孿生,以便隨時迭代場景并適配不同的傳感器布置和測試條件。傳統的外包式建模服務或半成品工具鏈,難以滿足客戶對自助操作和敏捷迭代的要求。

針對這些痛點,康謀推出的 World Extractor 已經不只是一個“內部項目工具",而是一個成熟、可商用、可自助使用的端到端工具鏈。它集成了 NeRF 與 3D Gaussian Splatting 等前沿神經重建技術,用戶只需將自己的實地錄制數據(如車隊采集的多傳感器數據)導入,即可在數天內自動生成靜態 3D 世界,無需專業 3D 建模師。

World Extractor工作前端用于評估采集數據質量和場景回放

在此基礎上,用戶可以通過內置的 2000+ 動態主體資產庫自主增強場景,添加車輛、行人、交通燈、標志牌等元素,并根據測試需求調整 ODD、時間、天氣和交通流量。

整個過程不再依賴團隊手工制作,客戶可以掌握采集、生成和仿真流程,形成自己的數字孿生資產庫,并與康謀 aiSim 直接聯動。

World Extractor 的價值在于與 aiSim 的原生集成。通過“神經重建 + 物理引擎"的混合渲染方式,既能保留真實世界的紋理和幾何細節,又能獲得物理上精確的傳感器輸出。

在 aiSim 中,用戶可一鍵配置多傳感器仿真,包括攝像頭、雷達、激光雷達、超聲波傳感器等,靈活調整天氣、光照和時間條件,驗證在少見場景下的算法表現。

World Extractor + aiSim的關鍵優勢在于:

(1)自動化管線:將高保真 3D 環境生成周期從傳統的 3–6 個月縮短到 1 天,實現真正意義上的“日級數字孿生"。

(2)傳感器無關:覆蓋攝像頭、雷達、激光雷達等所有主流傳感器模式,與大多數只關注單一傳感器的競爭產品相比更全面。

(3)新視角:即使偏離原始采集軌跡,依然能保持高精度渲染和傳感器一致性,適合多變路徑和復雜測試工況。

(4)量化驗證:通過感知功能等量化指標,域間差距極小,提供比純質性評估更可的驗證依據。

歐洲某乘用車OEM有構建3D孿生場景地圖,并基于aiSim開展SiL、HiL和DiL仿真測試的需求。

為滿足該需求,解決方案是利用aiSim、World extractor工具鏈(涵蓋采集、可視化分析、3DGS模型和自動標注功能),為客戶多個團隊創建覆蓋不同ODD的3D環境,這些環境可直接用于aiSim及客戶基于UE構建的DiL系統。

本項目KPI是采用World Extractor生成高質量合成數據,避免重復采集數據測試新傳感器方案,且將原本3 - 6月的數字孿生時間縮短到1天。

具體實施步驟為:

客戶自有數采車隊采集場景數據,用于3DGS場景重建;

基于采集數據構建3D模型,支持高保真交通、場景和傳感器仿真;

訓練3DGS數據孿生場景,并無縫導入aiSim中使用;

提供客戶自有UE引擎DiL模擬工具,實現駕駛員參與的閉環仿真測試。

在自動駕駛的競爭賽道上,高保真、可擴展的仿真場景構建已成為端到端系統級驗證的關鍵。

無論你是整車廠還是Tier1團隊,都可以借助 World Extractor + aiSim 快速搭建符合自身傳感器、算法和測試要求的高保真仿真環境,實現真正的端到端系統級驗證。

關注微信

關注微信